L’Europe déclare l’IA émotionnelle « à haut risque »

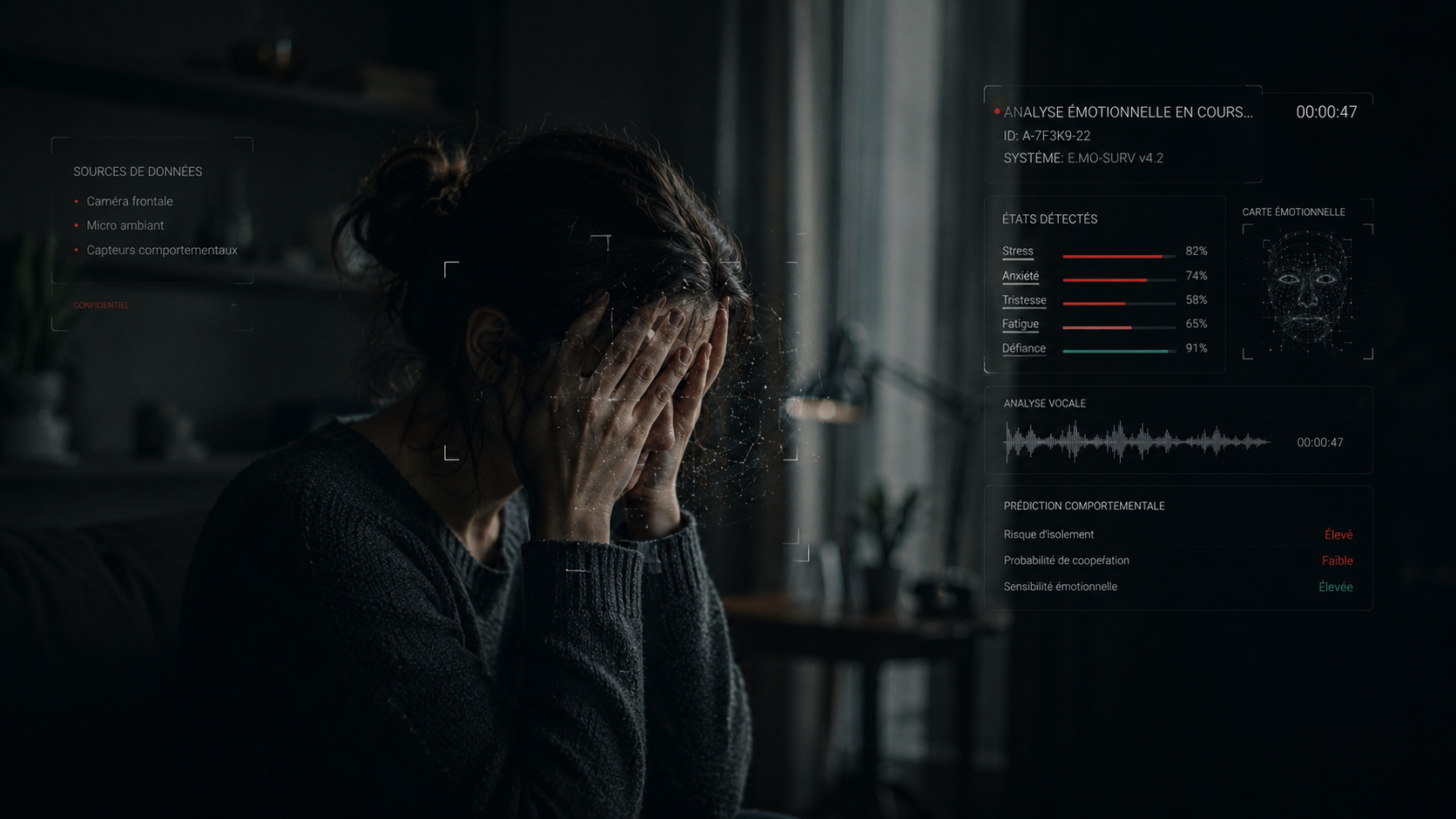

Anatomie d’un basculement invisible

Le calendrier initial de l’AI Act européen est clair : le 2 août 2026, la reconnaissance émotionnelle par IA bascule en catégorie « haut risque ». Si un accord provisoire conclu en mai 2026 pourrait repousser certaines obligations à 2027, la révolution, elle, est déjà en marche. Depuis février 2025, l’inférence émotionnelle est même strictement interdite au travail. Récit d’un basculement qui révèle ce que l’IA fait déjà de nos affects.

Votre voix trahit votre colère

Un mardi ordinaire dans un centre d'appels de la banlieue lyonnaise. Un client appelle pour contester une facture. Il n'a pas encore terminé sa deuxième phrase qu'un indicateur apparaît sur l'écran de l'agent : un score de frustration, calculé en temps réel à partir des micro-variations de sa voix : hauteur, débit, amplitude des hésitations.

Le score monte. L'agent le voit. Le client, lui, ne sait pas qu'une machine est en train de tenter d'interpréter ses émotions. Il ne sait pas que son intonation a été convertie en donnée, sa frustration en variable, son exaspération en signal exploitable. Il croit parler à un être humain. Il parle à un être humain mais un être humain assisté par une machine qui déchiffre ses affects en direct.

Cette scène se joue des milliers de fois par jour dans une indifférence quasi totale. Mais le cadre change. Le 2 août 2026 marque l'entrée en vigueur des dispositions « haut risque » de l'AI Act pour les services clients. Certes, les discussions de mai 2026 laissent planer la possibilité d'un sursis technique jusqu'en 2027 pour certains déploiements, mais la direction est irréversible : ces systèmes quittent la zone grise pour entrer dans l'une des réglementations les plus strictes au monde.

Une science contestée mais débattue

Pour comprendre ce que l'AI Act réglemente, il faut saisir l'ambiguïté fondamentale du secteur : la frontière entre détection et inférence.

L'IA excelle à détecter des signaux physiques : une accélération cardiaque, une paupière qui tombe, une voix qui monte. Ces mesures, lorsqu’elles servent à la sécurité routière (détection de fatigue) ou à la médecine, restent autorisées. Mais l'AI Act frappe là où la machine prétend passer de la donnée physique à l'état mental. C’est ce qu’on appelle l’inférence. Prétendre que parce que vous froncez les sourcils, vous êtes « en colère », ou que parce que votre voix tremble, vous êtes « peu fiable ».

Onze émotions sont ainsi visées : de la joie au mépris, de la honte au contentement. Le problème ? Cette prétention repose sur une science contestée. En 2019, la neuroscientifique Lisa Feldman Barrett a démontré qu’il n’existe pas de preuve fiable pour inférer un état émotionnel à partir des seuls mouvements du visage. Un sourire ne signifie pas toujours la joie. Aux États-Unis, on ne fronce les sourcils en étant en colère que dans 35 % des cas.

Ce que la machine détecte, ce ne sont pas des émotions, ce sont des configurations musculaires et des fréquences vocales qu'elle projette sur une grille statistique simpliste. Pourtant, sur la base de ces scores, des décisions sont prises : un candidat est écarté, un employé est jugé « désengagé ».

Le salarié sous écoute émotionnelle

L'aspect le plus radical de l'AI Act est déjà là, mais reste méconnu : depuis le 2 février 2025, la reconnaissance émotionnelle par IA est strictement interdite en milieu professionnel et dans l'éducation. Pas réglementée. Interdite.

Le paradoxe est cruel. Des systèmes continuent pourtant de noter les agents sur leur « ton empathique ». On demande à l’employé de performer des émotions authentiques tout en l’évaluant mécaniquement. L'IA ne vérifie pas si l'agent est sincère, elle vérifie si sa voix produit les marqueurs acoustiques de la sincérité. L'agent n'a plus à être empathique, il doit sonner empathique selon les critères d'un algorithme qui ignore tout de l'empathie. L'AI Act dit, pour la première fois : cette logique est incompatible avec la dignité humaine.

Le client scanné et le droit à l'intime

Pour les clients, le basculement « haut risque » (août 2026, sous réserve de décalage technique) impose une panoplie d'obligations vertigineuses : évaluations de conformité, supervision humaine effective et, surtout, une obligation de transparence. Le client devra être informé que sa voix est passée au crible de l'analyse émotionnelle.

Au-delà de la technique, l'Europe formule une intuition profonde : les émotions ne sont pas des données comme les autres. Le visage qui rougit, le soupir qui précède un aveu, la voix qui tremble... ce sont les manifestations de notre intériorité. En protégeant ces signaux, l'Europe affirme que l'émotion humaine n'est pas une ressource extractible.

Conclusion : Le droit de ne pas être lu

L'enjeu dépasse le calendrier réglementaire. Une société qui laisse des machines lire les émotions sans contrôle finit par produire des citoyens qui ne ressentent plus, mais qui « performent ». Des élèves qui affichent l'attention sans l'éprouver, des vendeurs qui simulent la bienveillance pour satisfaire un curseur. L'émotion se vide de son contenu pour ne conserver que sa forme algorithmique.

Ce que l'Europe protège, c'est le droit de ressentir sans être scoré. Le droit d'être en colère sans qu'un logiciel décide de la suite de votre vie. Le 2 août 2026 (ou 2027), un cadre juridique dira enfin que l'intériorité humaine n'est pas un gisement, que l'affect n'est pas un minerai, et que l'âme n'est pas une variable d'ajustement. Ce que l'AI Act interdit, au fond, c'est la transformation silencieuse de l'intime en infrastructure.

Cyrielle Soldani est analyste des transformations sociétales liées à l'IA émotionnelle et relationnelle. Son essai L'Algorithme du cœur est en cours d'écriture.

Sources principales

- Règlement (UE) 2024/1689, AI Act — articles 5 (pratiques prohibées) et 50 (obligations de transparence). Entrée en vigueur progressive : février 2025 (interdictions), août 2026 (haut risque).

- « EU AI Act Deadline: Customer Emotion AI Becomes High-Risk in August 2026 ». CX Today, avril 2026.

- « EU AI Act Shock: Emotion Recognition Is Now Illegal at Work ». UC Today, avril 2026.

- « The EU AI Act Takes Full Effect in August. Here's What It Actually Bans ». State of Surveillance, mars 2026.

- « Pseudoscientific Emotion AI Is Invading the Workplace ». The Atlantic / The Decoder, mai 2026.

- Barrett, L.F. et al. (2019). « Emotional Expressions Reconsidered ». Psychological Science in the Public Interest, 20(1), 1-68.

- Bird & Bird (2024). « What Is an Emotion Recognition System under the EU AI Act? ».

- « Tech Companies Claim AI Can Recognise Human Emotions. But the Science Doesn't Stack Up ». The Conversation, décembre 2025.

- « AI in Hiring Assessments: What HR Leaders Need to Know in 2026 ». Cogn-IQ.org, mars 2026.

- « China Is Home to a Growing Market for Dubious Emotion Recognition Technology ». Rest of World, 2023.

- « Emotion AI Marketing 2026 ». Spinta Digital, janvier 2026.